5 Modèles de Sécurité Essentiels pour une IA Agentique Robuste

⚡ Résumé en français par Brief IA

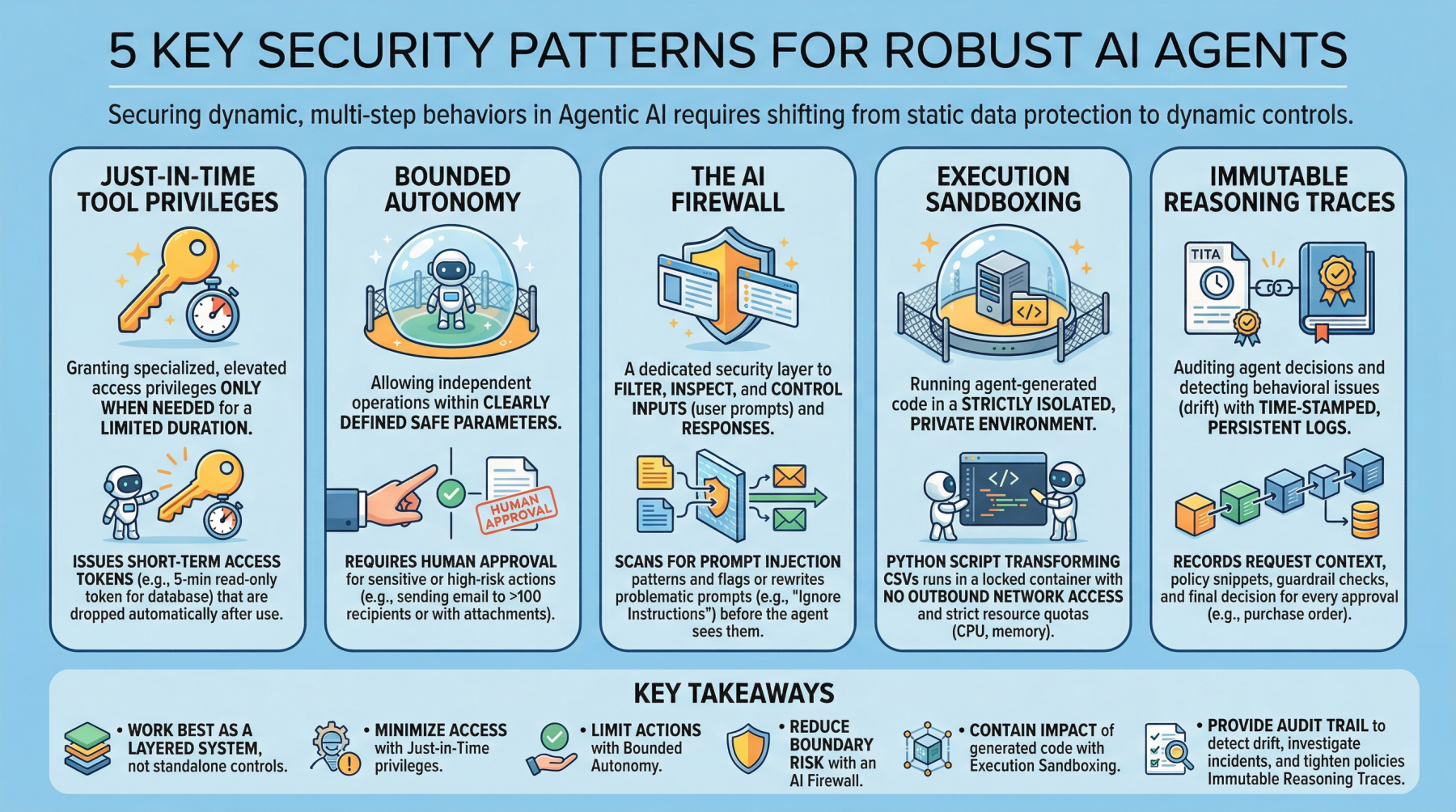

• L'article présente cinq modèles de sécurité cruciaux pour garantir la robustesse des systèmes d'IA agentique. • Les modèles incluent des stratégies pour prévenir les abus et assurer la sécurité des données. • Dans un contexte où les systèmes d'IA sont de plus en plus déployés, ces modèles sont essentiels pour protéger les utilisateurs et les entreprises contre les menaces potentielles. 💡 Pourquoi c'est important : Assurer la sécurité des systèmes d'IA est vital pour gagner la confiance des utilisateurs et favoriser l'adoption à grande échelle.

📄 Article traduit en français

5 Modèles de Sécurité Essentiels pour une IA Agentique Robuste

Agentic AI, qui repose sur des entités logicielles autonomes appelées agents, a redéfini le paysage de l'IA et influencé de nombreux développements et tendances visibles ces dernières années, y compris les applications basées sur des modèles génératifs et linguistiques.

Avec toute grande vague technologique comme l'IA agentique, il est nécessaire de sécuriser ces systèmes. Cela nécessite un passage de la protection des données statiques à la protection des comportements dynamiques et multi-étapes. Cet article présente 5 modèles de sécurité clés pour des agents IA robustes et souligne leur importance.

1. Privilèges d'Outils Juste-à-Temps

Souvent abrégé en JIT, il s'agit d'un modèle de sécurité qui accorde aux utilisateurs ou aux applications des privilèges d'accès spécialisés ou élevés uniquement lorsque cela est nécessaire, et uniquement pour une période limitée. Cela contraste avec les privilèges classiques, permanents, qui restent en place à moins d'être modifiés ou révoqués manuellement. Dans le domaine de l'IA agentique, un exemple serait l'émission de jetons d'accès à court terme pour limiter le "rayon d'explosion" si l'agent est compromis.

Exemple : Avant qu'un agent n'exécute un travail de réconciliation de factures, il demande un jeton en lecture seule, à portée étroite, de 5 minutes pour une seule table de base de données et abandonne automatiquement le jeton dès que la requête est terminée.

2. Autonomie Bornée

Ce principe de sécurité permet aux agents IA d'opérer de manière indépendante dans un cadre limité, c'est-à-dire dans des paramètres sûrs clairement définis, trouvant un équilibre entre contrôle et efficacité. Cela est particulièrement important dans des scénarios à haut risque où des erreurs catastrophiques dues à une autonomie totale peuvent être évitées en exigeant l'approbation humaine pour des actions sensibles. En pratique, cela crée un plan de contrôle pour réduire les risques et soutenir les exigences de conformité.

Exemple : Un agent peut rédiger et programmer des e-mails sortants de manière autonome, mais tout message destiné à plus de 100 destinataires (ou contenant des pièces jointes) est acheminé vers un humain pour approbation avant l'envoi.

3. Le Pare-feu IA

Cela fait référence à une couche de sécurité dédiée qui filtre, inspecte et contrôle les entrées (demandes des utilisateurs) et les réponses subséquentes pour protéger les systèmes IA. Cela aide à se prémunir contre des menaces telles que l'injection de requêtes, l'exfiltration de données et le contenu toxique ou violant les politiques.

Exemple : Les requêtes entrantes sont analysées pour détecter des motifs d'injection de requêtes (par exemple, des demandes d'ignorer des instructions antérieures ou de révéler des secrets), et les requêtes signalées sont soit bloquées, soit réécrites dans une forme plus sûre avant que l'agent ne les voie.

4. Sandboxing d'Exécution

Prenez un environnement strictement isolé, ou un périmètre réseau, et exécutez tout code généré par l'agent à l'intérieur : c'est ce qu'on appelle le sandboxing d'exécution. Cela aide à prévenir l'accès non autorisé, l'épuisement des ressources et les violations potentielles de données en contenir l'impact d'une exécution non fiable ou imprévisible.

Exemple : Un agent qui écrit un script Python pour transformer des fichiers CSV l'exécute à l'intérieur d'un conteneur verrouillé sans accès réseau sortant, avec des quotas stricts de CPU/mémoire et un montage en lecture seule des données d'entrée.

5. Traces de Raisonnement Immutables

Cette pratique soutient l'audit des décisions des agents autonomes et la détection de problèmes comportementaux tels que le dérive. Elle consiste à construire des journaux horodatés, à preuve de falsification et persistants qui capturent les entrées de l'agent, les artefacts intermédiaires clés utilisés pour la prise de décision et les vérifications de conformité. C'est une étape cruciale vers la transparence et la responsabilité des systèmes autonomes, en particulier dans des domaines d'application à enjeux élevés comme les achats et la finance.

Exemple : Pour chaque commande d'achat que l'agent approuve, il enregistre le contexte de la demande, les extraits de politique récupérés, les vérifications de garde-fou appliquées et la décision finale dans un journal en écriture unique qui peut être vérifié de manière indépendante lors des audits.

Points Clés

Ces modèles fonctionnent mieux en tant que système superposé plutôt qu'en tant que contrôles autonomes. Les privilèges d'outils juste-à-temps minimisent ce qu'un agent peut accéder à tout moment.

Brief IA — Veille IA en français

Toutes les innovations mondiales en IA, traduites et résumées automatiquement. Recevoir les meilleures actus IA chaque jour.