5 Techniques Pratiques pour Détecter et Atténuer les Hallucinations des LLM au-delà de l'Ingénierie des Prompts

Qu'est-ce qui cause les hallucinations dans les modèles de langage ?

Avant de voir comment corriger les hallucinations, il est utile de comprendre pourquoi elles se produisent. Les causes ne sont pas mystérieuses, mais elles sont faciles à négliger lorsque les sorties semblent convaincantes.

-

Manque de fondement : La plupart des modèles de langage n'ont pas accès à des données en temps réel ou vérifiées, sauf si vous les y connectez explicitement. Ils génèrent des réponses basées sur des motifs appris lors de l'entraînement, sans vérifier les faits contre une source en direct. Lorsque la réponse exacte manque, le modèle comble les lacunes.

-

Sur-généralisation : Ces modèles sont entraînés sur de grands ensembles de données diversifiés, ce qui signifie qu'ils apprennent des motifs larges plutôt que des vérités précises. Face à une question spécifique, ils peuvent combiner des fragments d'informations similaires en quelque chose qui semble correct mais ne l'est pas.

-

Pression intégrée pour toujours produire une réponse : Les modèles de langage sont conçus pour être utiles et réactifs. Au lieu de dire "Je ne sais pas", ils génèrent souvent la réponse la plus plausible possible. Cette tendance est utile pour la conversation, mais risquée lorsque l'exactitude est primordiale.

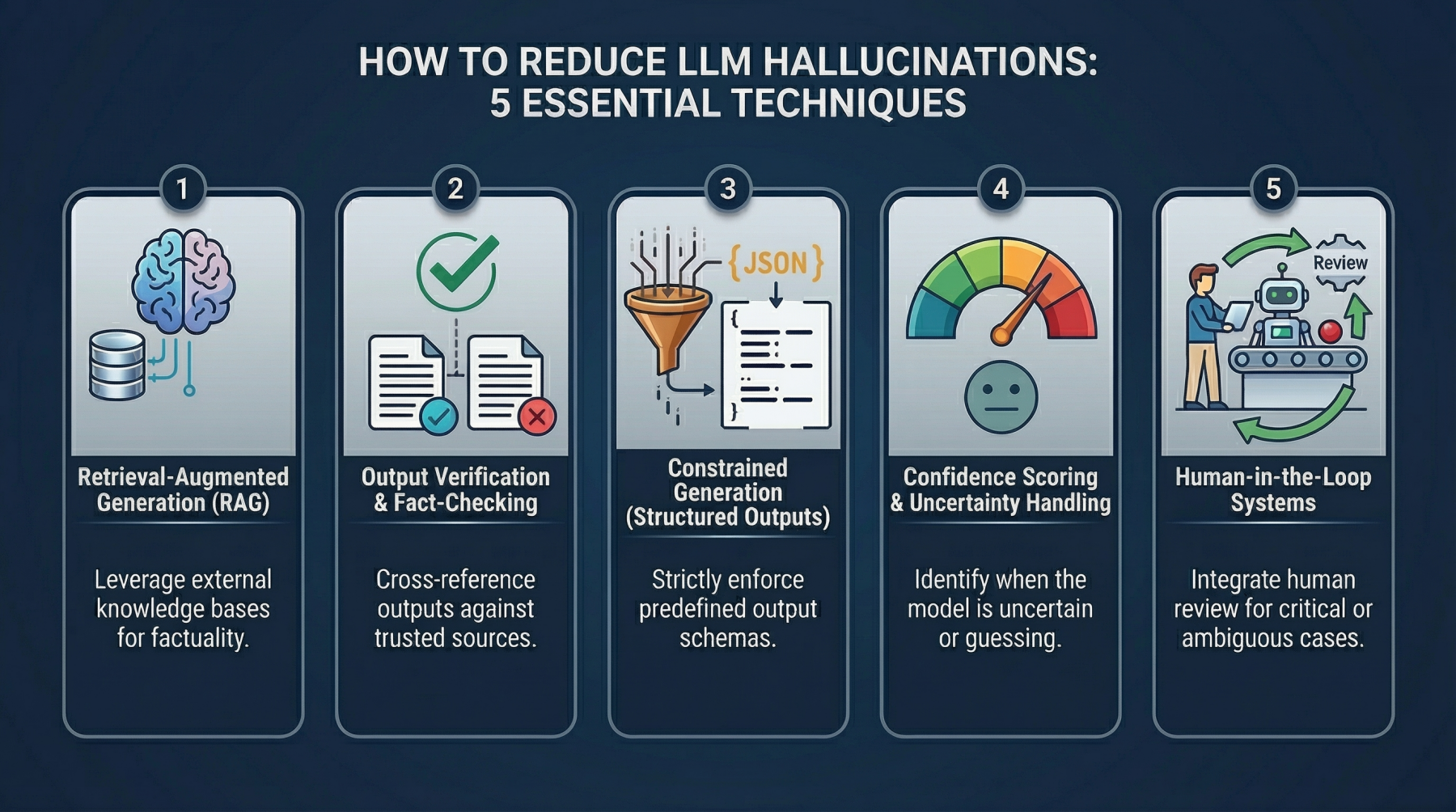

Technique 1 : Génération Augmentée par Récupération (RAG)

L'une des façons les plus efficaces de réduire les hallucinations est simple en principe. Il s'agit de ne pas se fier uniquement à ce que le modèle se souvient, mais de lui donner accès à des données réelles au moment où il doit répondre.

- Génération augmentée par récupération (RAG) : Au lieu de demander au modèle de générer une réponse uniquement à partir de son entraînement interne, vous récupérez d'abord des informations pertinentes d'une source externe, puis vous passez ces informations au modèle comme contexte.

Le flux est simple : un utilisateur pose une question, le système recherche dans une base de connaissances du contenu connexe, et le modèle génère une réponse basée sur ces données récupérées.

Cette approche modifie le comportement du modèle. Sans récupération, il s'appuie sur des motifs et des probabilités, ce qui est à l'origine des hallucinations. Avec la récupération, il a quelque chose de concret sur lequel travailler. Il ne devine plus ce qui pourrait être vrai, mais travaille avec ce qui a été fourni.

Technique 2 : Vérification des Sorties et Couches de Vérification des Faits

Une des erreurs les plus courantes avec les LLM est de traiter la première réponse comme définitive. Elle peut sembler bien formulée, confiante et, dans de nombreux cas, correcte. C'est précisément pourquoi les hallucinations passent inaperçues.

- Couches de vérification : Au lieu de se fier à une seule réponse du modèle, vous introduisez des étapes supplémentaires qui vérifient, valident ou remettent en question ce qui a été généré avant qu'il n'atteigne l'utilisateur.

Une approche courante consiste à utiliser un modèle secondaire pour la vérification. Le premier modèle génère la réponse, et un second modèle la passe en revue. Le réviseur peut vérifier la cohérence factuelle, signaler des affirmations non soutenues, ou même comparer la réponse à des sources connues.

Une autre approche consiste à croiser les sorties avec des sources de données fiables. Par exemple, si une réponse inclut des statistiques, des citations ou des détails techniques, le système peut vérifier ces informations contre une base de données, une API ou une base de connaissances interne. Si l'information ne peut pas être confirmée, le système peut soit rejeter la réponse, soit demander des éclaircissements.

Conclusion

Ces techniques, parmi d'autres, permettent de mieux gérer les hallucinations des modèles de langage. En adoptant une approche systémique et en intégrant des vérifications et des données externes, il est possible d'améliorer la fiabilité des réponses générées par ces modèles.

📧

Cet article vous a plu ?

Recevez les 7 meilleures actus IA chaque soir à 19h — résumées en 5 min.