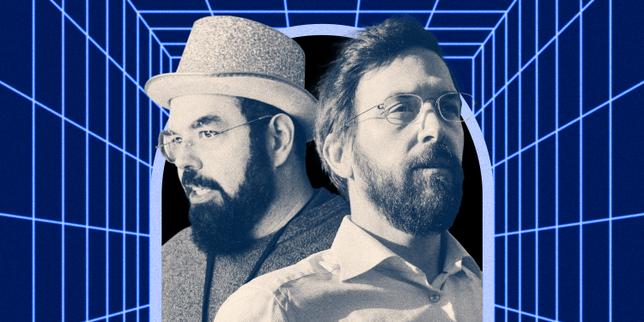

Eliezer Yudkowsky et Nate Soares, « cavaliers de l’Apocalypse » de l’IA

Eliezer Yudkowsky est un « doomer » de la première heure, un de ces « cavaliers de l’Apocalypse » qui ont mis en garde sur les dangers existentiels de l’intelligence artificielle (IA) avant même qu’elle n’existe. C’est en 2000, il y a un quart de siècle, alors qu’il était âgé d’une vingtaine d’années à peine, que ce natif de Chicago, éduqué dans l’orthodoxie juive mais devenu athée, crée à Atlanta, puis à Berkeley, en Californie, le Machine Intelligence Research Institute (MIRI), pour travailler sur l’IA.

Doté d’un quotient intellectuel hors norme, le jeune homme, qui a quitté l’école au collège pour raisons de santé, choisit de passer outre les études universitaires. Il se passionne pour le moment où la machine dépassera le cerveau humain. Mais, bien vite, il estime déceler un problème : le non-alignement des valeurs de l’IA avec celles de l’homme. Il décide alors de concentrer ses recherches sur le sujet d’une « IA amicale ».

Parmi les idées explorées, Eliezer Yudkowsky popularise, avec le philosophe d’Oxford Nick Bostrom, auteur, en 2014, de Superintelligence (publié chez Dunod en 2017), des concepts comme l’« orthogonalité » – notion selon laquelle l’intelligence et la bienveillance sont des traits distincts, et un système d’IA ne deviendrait pas automatiquement plus amical à mesure qu’il gagnerait en intelligence – et la « convergence instrumentale », l’idée qu’un système d’IA puissant et orienté vers un objectif pourrait adopter des stratégies finissant par nuire aux êtres humains.

📧

Cet article vous a plu ?

Recevez les 7 meilleures actus IA chaque soir à 19h — résumées en 5 min.