Gemma 4 de Google : une IA agentique gratuite sur votre téléphone sans transfert de données

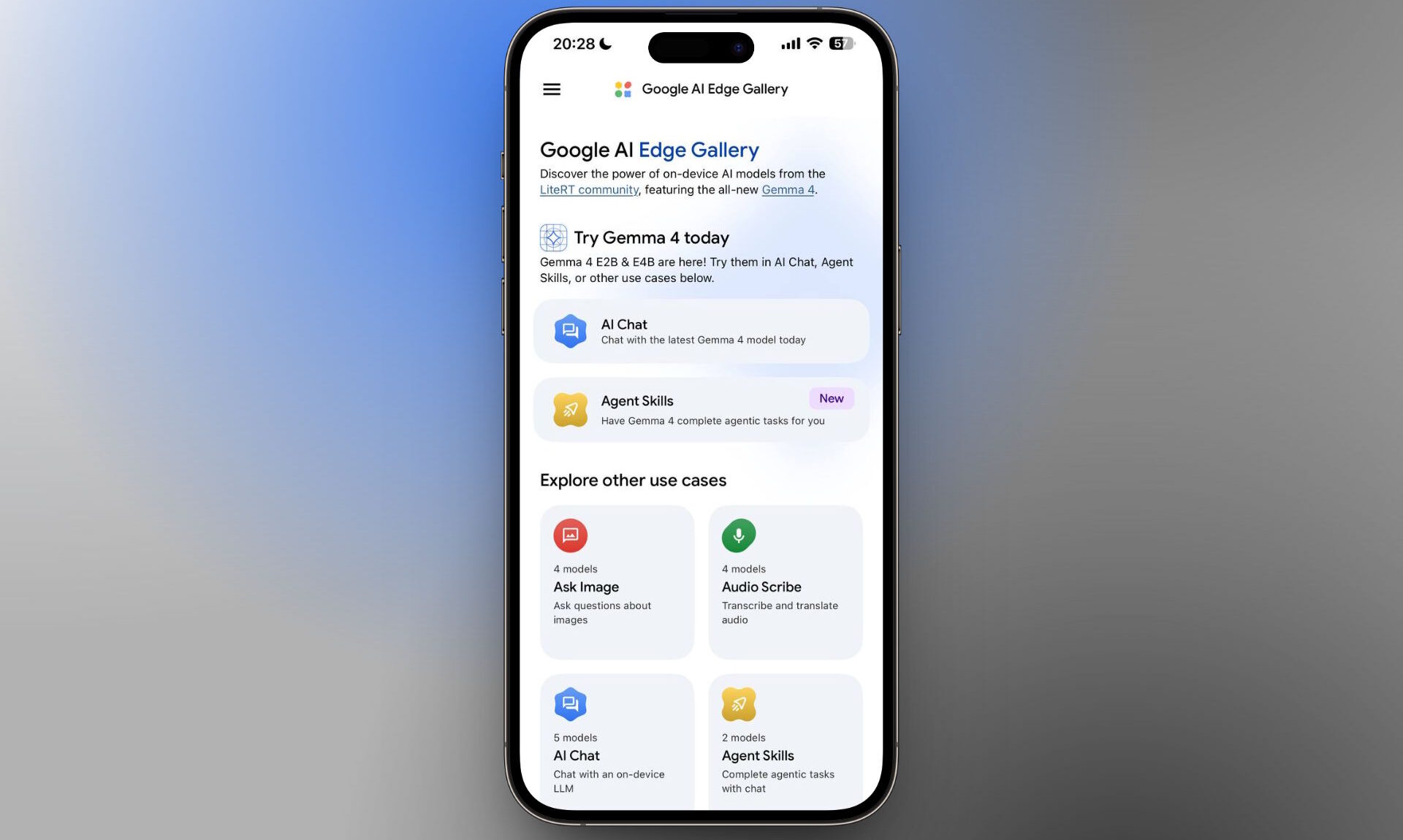

Le modèle open-source de Google, Gemma 4, peut traiter du texte, des images et de l'audio entièrement sur l'appareil, utilisant de manière autonome des outils comme Wikipedia, des cartes interactives ou des générateurs de QR codes grâce à des compétences d'agent intégrées.

Les variantes de smartphone plus petites, E2B et E4B, fonctionnent sur des appareils avec seulement 6 et 8 Go de RAM respectivement, offrant jusqu'à quatre fois la vitesse de la génération précédente selon Google, et servent de base pour le futur Gemini Nano 4 sur Android.

Tous les modèles sont publiés sous la licence Apache 2.0, favorable aux entreprises, permettant aux développeurs de créer et de partager des compétences personnalisées via GitHub. L'application gratuite Google AI Edge Gallery est disponible pour Android et iOS.

Gemma 4 est construit sur la même recherche que le modèle propriétaire de Google, Gemini 3, mais est distribué sous la licence Apache 2.0. Google affirme que la famille Gemma a accumulé plus de 400 millions de téléchargements depuis le lancement de la première génération. Tous les modèles gèrent du texte, des images et de l'audio dans plus de 140 langues.

Quatre tailles de modèles couvrent tout, des téléphones aux serveurs

La dernière version se décline en quatre variantes. E2B et E4B sont spécifiquement conçus pour les smartphones. Le "E" signifie "paramètres effectifs", c'est-à-dire le nombre de paramètres réellement actifs lors de l'inférence. Quantifié, E2B occupe environ 1,3 Go sur l'appareil, tandis que E4B nécessite environ 2,5 Go.

Les plus grandes variantes, 26B et 31B, ciblent les serveurs et le matériel haute performance. La version 26B utilise une architecture à mélange d'experts avec 128 experts, donc seulement 3,8 milliards de paramètres sont actifs à tout moment. Le modèle dense 31B offre une fenêtre de contexte allant jusqu'à 256 000 tokens.

Google a également collaboré avec Arm et Qualcomm pour optimiser les variantes pour les puces mobiles actuelles. Selon Google, Gemma 4 sur Android fonctionne jusqu'à quatre fois plus vite que la génération précédente tout en réduisant la consommation de batterie de jusqu'à 60 %. Les propres benchmarks d'Arm montrent même des gains plus importants : un gain de vitesse moyen de 5,5 fois dans le traitement, à condition que l'appareil soit équipé d'une puce Arm plus récente avec l'ensemble d'instructions SME2, une extension qui accélère les calculs matriciels pour les modèles d'IA directement dans le silicium.

Les compétences d'agent apportent l'utilisation d'outils à l'IA sur appareil

L'application nécessite Android 12 ou iOS 17. Les deux variantes de taille téléphone diffèrent par leurs exigences en matière de RAM : E2B utilise environ 1,3 Go quantifié et fonctionne sur des appareils avec 6 Go de RAM, tandis que E4B nécessite environ 2,5 Go de mémoire modèle et au moins 8 Go de RAM.

Les compétences d'agent peuvent être activées et gérées individuellement. Gemma 4 génère un QR code directement sur l'appareil en utilisant une compétence JavaScript.

Au-delà du chat de base, de la reconnaissance d'images et de la transcription audio, l'application est livrée avec ce que Google appelle des "compétences d'agent" : recherche Wikipedia, cartes interactives, résumés générés automatiquement et flashcards. Gemma 4 peut également décrire des photos, transformer des entrées vocales en diagrammes et visualisations, et même collaborer avec d'autres modèles locaux pour des tâches comme la synthèse vocale ou la génération d'images. Google le démontre avec une compétence de démonstration qui décrit et joue des appels d'animaux.

La reconnaissance d'images a également bénéficié d'une solide mise à jour, selon Google. Les tâches d'OCR, extrayant du texte d'images, de diagrammes ou d'écritures manuscrites, offrent désormais des résultats nettement meilleurs. Le modèle gère également les informations temporelles de manière plus fiable, ce qui est important pour les calendriers, les rappels et les alarmes.

Gemma 4 détecte l'intention derrière l'entrée de l'utilisateur et active automatiquement la bonne compétence, ici, un suivi d'humeur avec un graphique d'historique.

Individuellement, aucune de ces fonctionnalités ne révolutionne par rapport à ce que les fournisseurs de cloud offrent déjà. Ce qui se démarque, c'est qu'une application de démonstration exécutant un modèle purement local sur un téléphone peut désormais utiliser ces outils de manière autonome. Les développeurs peuvent créer des compétences personnalisées via GitHub et les partager avec la communauté. Les outils intégrés nécessitent une connexion Internet, mais le modèle lui-même fonctionne localement, et les discussions ne sont jamais sauvegardées.

Gemma 4 prépare le terrain pour le prochain Gemini Nano

Selon Google, Gemma 4 E2B et E4B servent de base pour Gemini Nano 4, la prochaine génération du modèle sur appareil à l'échelle du système Android. Le code écrit pour Gemma 4 aujourd'hui fonctionnera avec Gemini Nano 4 dès sa sortie sur de nouveaux appareils phares plus tard cette année. Gemini Nano fonctionne déjà sur plus de 140 millions d'appareils Android, alimentant des fonctionnalités telles que les Réponses intelligentes et les résumés audio.

En décembre, Google a prévisualisé cette direction avec FunctionGemma, un petit modèle local avec seulement 270 millions de paramètres qui peut acheminer des commandes vers d'autres applications de téléphone. Il traduit le langage naturel en appels de fonction structurés : activer la lampe de poche, créer des contacts, envoyer des e-mails, ajouter des entrées de calendrier, afficher des emplacements sur une carte ou ouvrir les paramètres Wi-Fi.

L'importance stratégique de l'IA sur appareil est devenue claire plus tôt cette année avec l'accord d'un milliard de dollars entre Apple et Google. Depuis janvier, nous savons que la prochaine génération de Foundation Models d'Apple sera construite sur la technologie Gemini de Google, alimentant une mise à niveau complète de Siri au cours de 2025.

📧

Cet article vous a plu ?

Recevez les 7 meilleures actus IA chaque soir à 19h — résumées en 5 min.