J'ai construit un pare-feu d'ontologie pour Microsoft Copilot en 48 heures — Voici le code de production

⚡ Résumé en français par Brief IA

📄 Article traduit en français

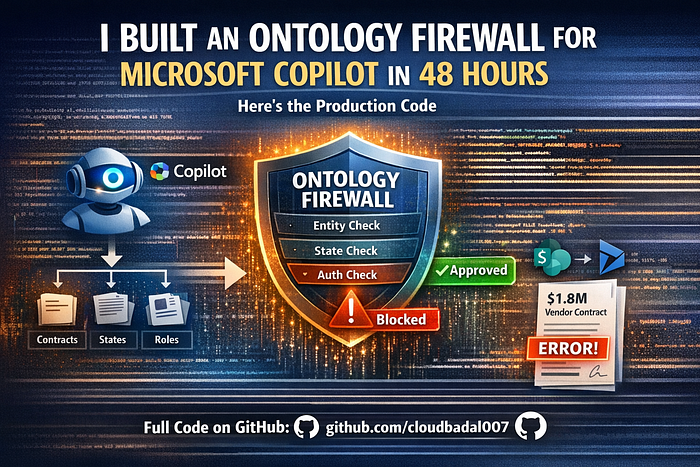

J'ai construit un pare-feu d'ontologie pour Microsoft Copilot en 48 heures — Voici le code de production

La plupart des déploiements de Copilot sont à un mauvais acte d'agent près d'un échec de production sérieux. Voici l'architecture qui prévient cela.

Le Copilot avait lu un document SharePoint intitulé « Liste de fournisseurs pré-approuvés — Projet » et avait interprété « Pré-approuvé » comme une autorisation de procéder. Le mot « Projet » figurait dans le nom du fichier. L'agent ne l'a jamais vérifié.

Cet article détaille la construction d'un Pare-feu d'ontologie spécifiquement conçu pour Microsoft Copilot, mettant en lumière les risques inhérents aux déploiements qui manquent de protections adéquates. À travers le récit d'un incident réel impliquant l'approbation non autorisée d'un contrat de plusieurs millions de dollars, l'article souligne l'importance d'une couche sémantique robuste dans les opérations d'IA.

Il fournit également un guide de construction, décomposé en étapes séquentielles, pour créer et déployer le Pare-feu d'ontologie, en insistant sur sa nécessité pour maintenir la conformité et l'intégrité opérationnelle dans les environnements d'entreprise.

Brief IA — Veille IA en français

Toutes les innovations mondiales en IA, traduites et résumées automatiquement. Recevoir les meilleures actus IA chaque jour.