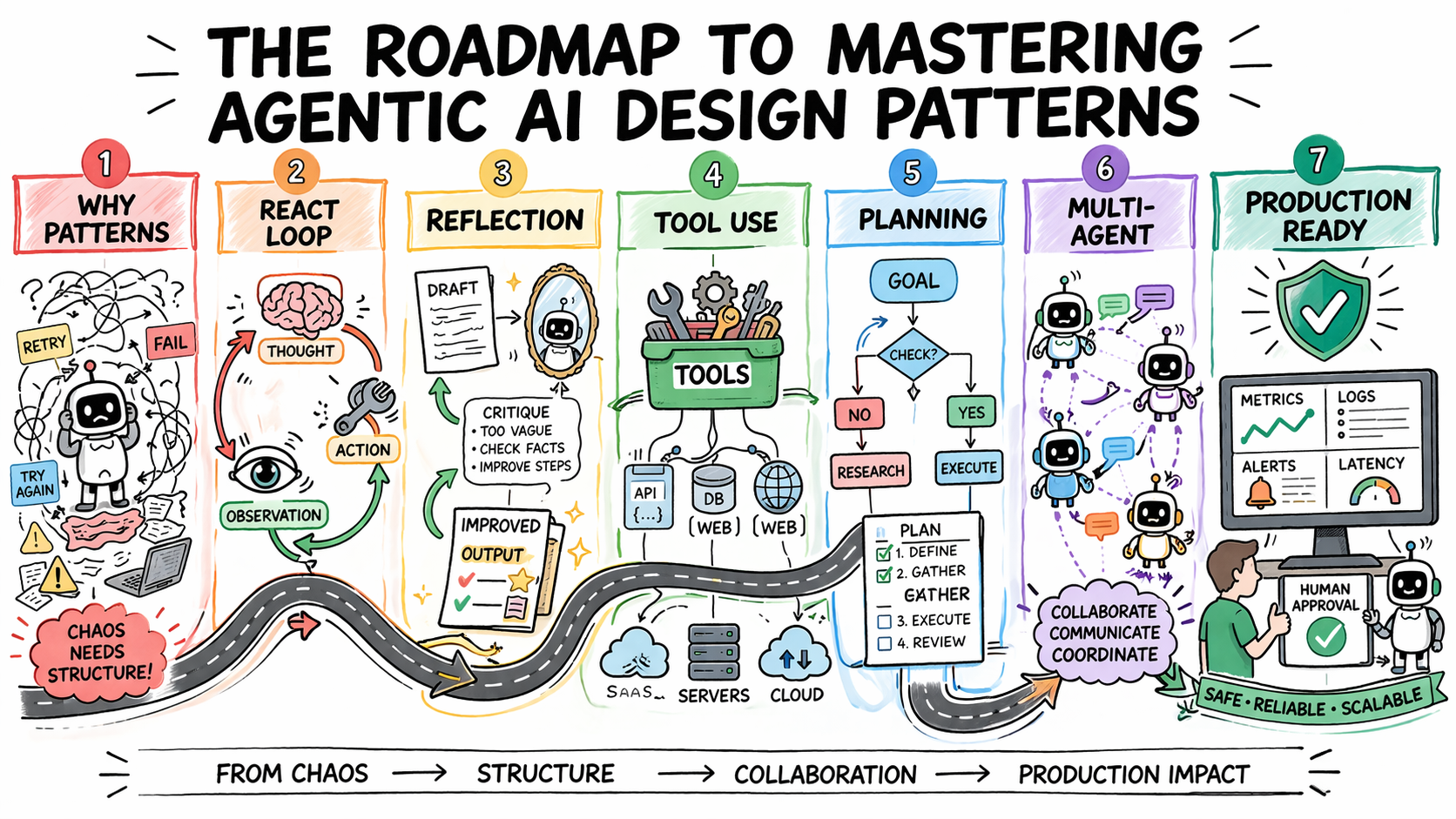

La feuille de route pour maîtriser les modèles de conception d'IA agentique

Introduction

La plupart des systèmes d'IA agentique sont construits modèle par modèle, décision par décision, sans cadre directeur sur la manière dont l'agent doit raisonner, agir, récupérer des erreurs ou déléguer des tâches à d'autres agents. Sans structure, le comportement des agents est difficile à prédire, plus compliqué à déboguer et presque impossible à améliorer de manière systématique. Le problème s'aggrave dans les flux de travail à plusieurs étapes, où une mauvaise décision au début d'un processus affecte chaque étape suivante.

Les modèles de conception agentique sont des approches réutilisables pour des problèmes récurrents dans la conception de systèmes agentiques. Ils aident à établir comment un agent raisonne avant d'agir, comment il évalue ses propres résultats, comment il sélectionne et utilise des outils, comment plusieurs agents se répartissent les responsabilités, et quand un humain doit intervenir. Choisir le bon modèle pour une tâche donnée rend le comportement de l'agent prévisible, débogable et composable à mesure que les exigences évoluent.

Cet article propose une feuille de route pratique pour comprendre les modèles de conception d'IA agentique. Il explique pourquoi la sélection des modèles est une décision architecturale, puis examine les modèles de conception agentique essentiels utilisés en production aujourd'hui. Pour chacun, il aborde quand le modèle est approprié, quels compromis il entraîne et comment les modèles s'imbriquent dans des systèmes réels.

Étape 1 : Comprendre pourquoi les modèles de conception sont nécessaires

Avant d'étudier un modèle spécifique, vous devez reformuler ce que vous essayez réellement de résoudre. L'instinct de nombreux développeurs est de traiter les échecs des agents comme des échecs de prompt. Si l'agent a fait quelque chose de faux, la solution est un meilleur prompt système. Parfois, cela est vrai. Mais plus souvent, l'échec est architectural.

- Un agent qui boucle indéfiniment échoue parce qu'aucune condition d'arrêt explicite n'a été conçue dans la boucle.

- Un agent qui appelle des outils de manière incorrecte n'a pas de contrat clair sur quand invoquer quel outil.

- Un agent qui produit des résultats incohérents avec des entrées identiques fonctionne sans un cadre décisionnel structuré.

Les modèles de conception existent pour résoudre exactement ces problèmes. Ce sont des modèles architecturaux répétables qui définissent comment la boucle d'un agent doit se comporter : comment il décide quoi faire ensuite, quand s'arrêter, comment récupérer des erreurs et comment interagir de manière fiable avec des systèmes externes. Sans eux, le comportement de l'agent devient presque impossible à déboguer ou à mettre à l'échelle.

Il existe également un problème de sélection de modèle qui freine les équipes dès le départ. La tentation est de se tourner vers le modèle le plus capable et le plus sophistiqué disponible — systèmes multi-agents, orchestration complexe, planification dynamique. Mais le coût de la complexité prématurée dans les systèmes agentiques est élevé. Plus d'appels de modèles signifient une latence et des coûts de jetons plus élevés. Plus d'agents signifient plus de surfaces d'échec. Plus d'orchestration signifie plus de bugs de coordination. L'erreur coûteuse est de sauter vers des modèles complexes avant d'avoir atteint des limites claires avec des modèles plus simples.

L'implication pratique :

- Traitez la sélection de modèle comme vous traiteriez toute décision architecturale en production.

- Commencez par le problème, pas par le modèle.

- Définissez ce que l'agent doit faire, ce qui peut mal tourner, et à quoi ressemble un fonctionnement correct.

- Ensuite, choisissez le modèle le plus simple qui répond à ces exigences.

Étape 2 : Apprendre le modèle ReAct comme point de départ par défaut

ReAct — Raisonnement et Action — est le modèle de conception agentique le plus fondamental et le bon choix par défaut pour la plupart des tâches complexes et imprévisibles. Il combine le raisonnement en chaîne de pensée avec l'utilisation d'outils externes dans une boucle de rétroaction continue.

La structure alterne entre trois phases :

- Pensée : l'agent raisonne sur ce qu'il doit faire ensuite.

- Action : l'agent invoque un outil, appelle une API ou exécute du code.

- Observation : l'agent traite le résultat et met à jour son plan.

Cela se répète jusqu'à ce que la tâche soit terminée ou qu'une condition d'arrêt soit atteinte.

Ce qui rend le modèle efficace, c'est qu'il externalise le raisonnement. Chaque décision est visible, donc lorsque l'agent échoue, vous pouvez voir exactement où la logique a échoué plutôt que de déboguer une sortie en boîte noire. Cela empêche également des conclusions prématurées en ancrant chaque étape de raisonnement dans un résultat observable avant de continuer, ce qui réduit les hallucinations lorsque les modèles sautent à des réponses sans retour d'information du monde réel.

Les compromis sont réels. Chaque itération de boucle nécessite un appel de modèle supplémentaire, augmentant la latence et le coût. Une sortie d'outil incorrecte se propage dans les étapes de raisonnement suivantes. Le comportement non déterministe du modèle signifie que des entrées identiques peuvent produire des chemins de raisonnement différents, ce qui crée des problèmes de cohérence dans des environnements réglementés. Sans une limite d'itération explicite, la boucle peut s'exécuter indéfiniment et les coûts peuvent rapidement s'accumuler.

Utilisez ReAct lorsque le chemin de solution n'est pas prédéterminé : résolution de problèmes adaptative, recherche multi-sources et flux de travail de support client avec complexité variable. Évitez-le lorsque la vitesse est la priorité ou lorsque les entrées sont suffisamment bien définies pour qu'un flux de travail fixe soit plus rapide et moins coûteux.

Étape 3 : Ajouter la réflexion pour améliorer la qualité des sorties

La réflexion donne à un agent la capacité d'évaluer et de réviser ses propres sorties avant qu'elles n'atteignent l'utilisateur. La structure est un cycle de génération-critique-affinement : l'agent produit une sortie initiale, l'évalue par rapport à des critères de qualité définis, et utilise cette évaluation comme base pour la révision. Le cycle se déroule pendant un nombre d'itérations défini ou jusqu'à ce que la sortie atteigne un seuil défini.

Le modèle est particulièrement efficace lorsque la critique est spécialisée. Un agent examinant du code peut se concentrer sur des bugs, des cas limites ou des problèmes de sécurité. Un agent examinant un contrat peut vérifier les clauses manquantes ou les incohérences logiques. Connecter l'étape de critique à des outils de vérification externes — un linter, un compilateur ou un validateur de schéma — renforce encore les gains, car l'agent reçoit un retour d'information déterministe plutôt que de se fier uniquement à son propre jugement.

Cependant, quelques décisions de conception sont importantes. Le critique doit être indépendant du générateur — au minimum, un prompt système séparé avec des instructions différentes ; dans des applications à enjeux élevés, un modèle complètement différent. Cela empêche le critique d'hériter des mêmes angles morts que le générateur et de produire un accord superficiel plutôt qu'une évaluation authentique. Des limites d'itération explicites sont également non négociables. Sans un nombre maximum de boucles, un agent qui continue de trouver des améliorations marginales va stagner plutôt que de converger.

La réflexion est le bon modèle lorsque la qualité de sortie compte plus que la vitesse et lorsque les tâches ont des critères de correction suffisamment clairs pour être évalués systématiquement. Elle ajoute des coûts et de la latence qui ne valent pas la peine d'être payés pour des requêtes factuelles simples ou des applications avec des contraintes strictes en temps réel.

Étape 4 : Faire de l'utilisation d'outils une décision architecturale de premier plan

L'utilisation d'outils est le modèle qui transforme un agent d'un système de connaissance en un système d'action. Sans cela, un agent n'a pas d'informations actuelles, pas d'accès à des systèmes externes, et aucune capacité à déclencher des actions dans le monde réel. Avec cela, un agent peut appeler des API, interroger des bases de données, exécuter du code, récupérer des documents et interagir avec des plateformes logicielles. Pour presque tous les agents de production gérant des tâches réelles, l'utilisation d'outils est la fondation sur laquelle tout le reste se construit.

La décision architecturale la plus importante est de définir un catalogue d'outils fixe avec des schémas d'entrée et de sortie stricts. Sans schémas clairs, l'agent devine comment appeler des outils, et ces suppositions échouent dans des cas limites. Les descriptions d'outils doivent être suffisamment précises pour que l'agent raisonne correctement sur quel outil s'applique à une situation donnée. Trop vagues, vous obtenez des appels mal assortis ; trop étroites, l'agent manque des cas d'utilisation valides.

La deuxième décision critique est de gérer les échecs d'outils. Un agent qui hérite des problèmes de fiabilité de ses outils sans aucune logique de gestion des échecs est fragile en proportion de l'instabilité de ses dépendances externes. Les API limitent le taux, expirent, retournent des formats inattendus et changent de comportement après des mises à jour. La couche d'outils de votre agent doit inclure une gestion explicite des erreurs, une logique de réessai et des chemins de dégradation gracieuse pour les cas où les outils ne sont pas disponibles.

L'exactitude de la sélection des outils est une préoccupation plus subtile mais tout aussi importante. À mesure que les bibliothèques d'outils se développent, les agents doivent raisonner sur des catalogues plus larges pour trouver le bon outil pour chaque tâche. Les performances en matière de sélection d'outils tendent à se dégrader à mesure que la taille du catalogue augmente. Un principe de conception utile est de structurer les interfaces d'outils de manière à ce que les distinctions entre les outils soient claires et sans ambiguïté.

Enfin, l'utilisation d'outils comporte une surface de sécurité que les développeurs d'agents sous-estiment souvent. Une fois qu'un agent peut interagir avec des systèmes réels — soumettre des formulaires, mettre à jour des enregistrements, déclencher des transactions — le rayon d'impact des erreurs augmente considérablement. Des environnements d'exécution isolés et des portes d'approbation humaine sont essentiels pour les invocations d'outils à haut risque.

Étape 5 : Savoir quand planifier avant d'agir

La planification est le modèle pour les tâches où la complexité ou...

📧

Cet article vous a plu ?

Recevez les 7 meilleures actus IA chaque soir à 19h — résumées en 5 min.