Lorsque les modèles linguistiques hallucinent, ils laissent des traces de "énergie renversée" dans leurs propres calculs

⚡ Résumé en français par Brief IA

📄 Article traduit en français

Lorsque les modèles linguistiques hallucinent

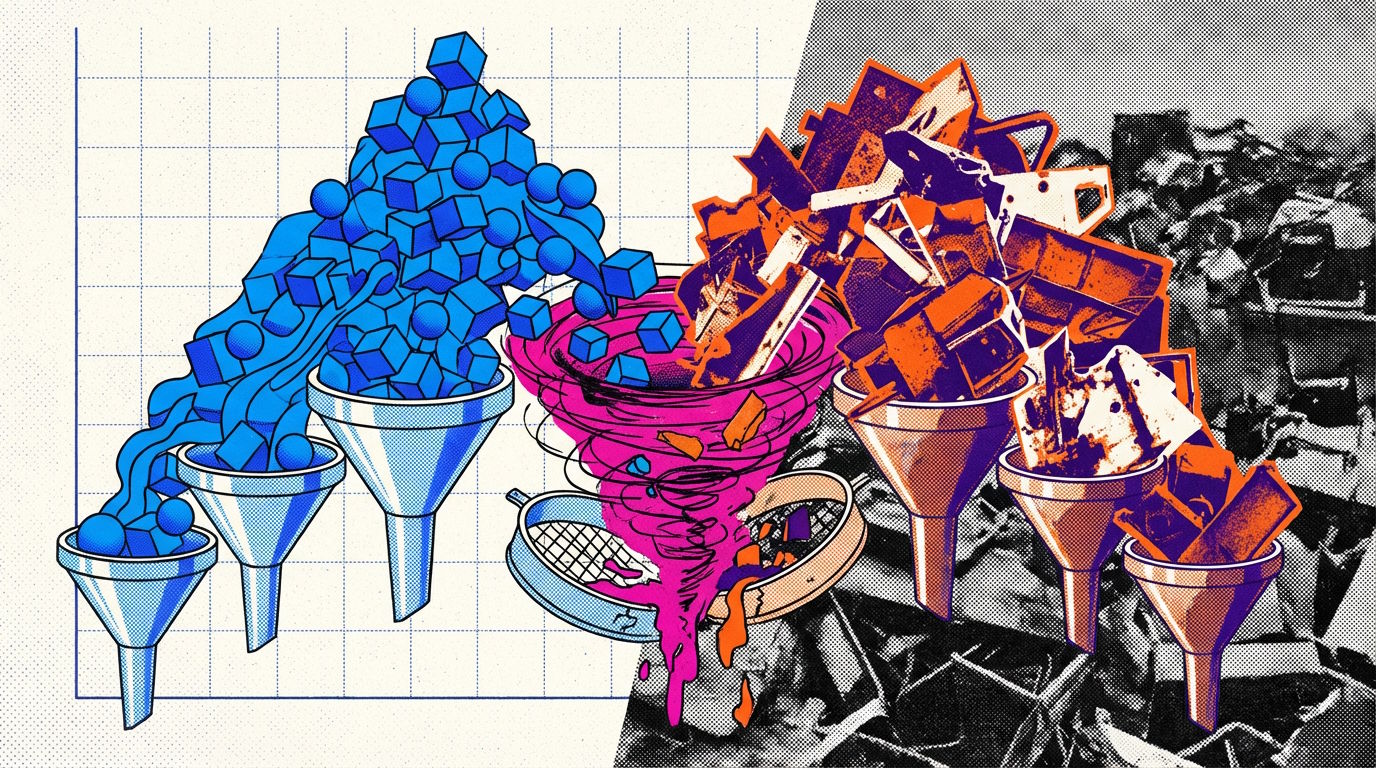

Lorsque les grands modèles linguistiques hallucinent, ils laissent des traces mesurables dans leurs propres calculs. Des chercheurs de l'Université Sapienza de Rome ont développé une méthode sans entraînement qui détecte ces traces et se généralise mieux que les approches précédentes.

L'article "Lorsque les modèles linguistiques hallucinent, ils laissent de l'énergie renversée dans leurs propres calculs" est apparu en premier sur The Decoder.

Brief IA — Veille IA en français

Toutes les innovations mondiales en IA, traduites et résumées automatiquement. Recevoir les meilleures actus IA chaque jour.