Olmo Hybride et les futures architectures LLM

⚡ Résumé en français par Brief IA

• Le modèle Olmo est au cœur des discussions sur les outils de post-formation open-source. • L'Olmo Hybrid représente une avancée significative dans le domaine des LLM avec des performances améliorées. • Ce développement s'inscrit dans un contexte où les outils open-source gagnent en popularité face aux solutions propriétaires. 💡 Pourquoi c'est important : L'innovation dans les architectures LLM pourrait transformer l'accès et l'efficacité des outils d'IA pour les développeurs et les entreprises.

📄 Article traduit en français

Olmo Hybride et les futures architectures LLM

Les architectures hybrides ne sont pas nouvelles dans le domaine des modèles à poids ouverts. Nous avons récemment vu apparaître le Qwen 3.5 (prévisualisé par Qwen3-Next), le Kimi Linear l'automne dernier (une version plus petite que leurs modèles phares Kimi K2), le Nemotron 3 Nano de Nvidia (avec des modèles plus grands à venir), le Granite 4 d'IBM, et d'autres modèles moins notables. C'est l'un de ces moments où une tendance de recherche semble être adoptée partout en même temps (peut-être que l'optimiseur Muon suivra bientôt ?).

Pour raconter cette histoire, nous devons remonter à quelques années, en décembre 2023, lorsque Mamba et Striped Hyena ont fait sensation — posant la question : avons-nous besoin d'une attention complète dans nos modèles ? Ces premiers modèles ont rapidement disparu, en partie pour les mêmes raisons qui les rendent difficiles aujourd'hui — des implémentations complexes, des problèmes d'outils open-source, des maux de tête supplémentaires lors de l'entraînement — mais aussi parce que les modèles ont montré des limites lorsqu'ils ont été mis à l'échelle. Les modèles hybrides de l'époque n'étaient pas encore suffisamment performants.

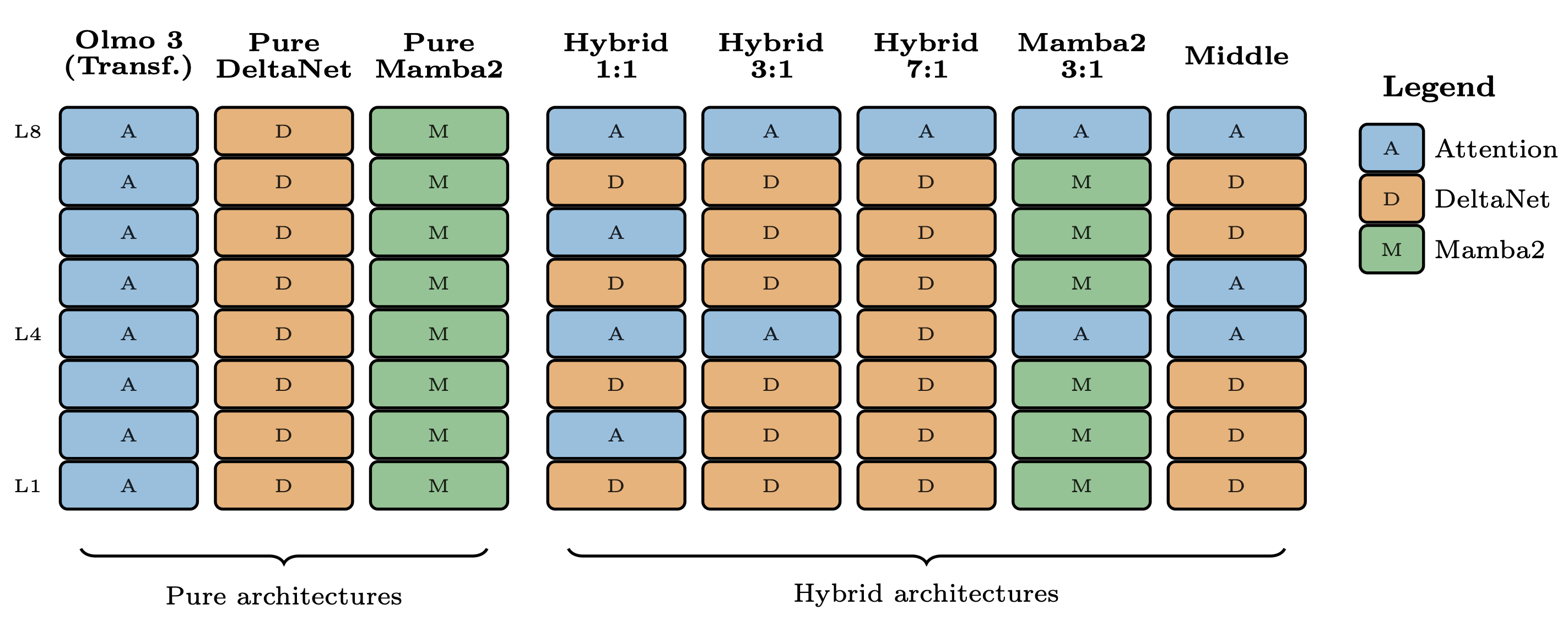

Ces modèles sont appelés hybrides car ils mélangent de nouveaux modules de réseaux de neurones récurrents (RNN) avec l'attention traditionnelle qui a rendu le transformer célèbre. Ils fonctionnent tous mieux avec ce mélange de modules. Les couches RNN conservent une partie du calcul compressée dans un état caché à utiliser pour le prochain token dans la prédiction — un résumé de toutes les informations précédentes — une idée qui a une longue lignée historique dans l'apprentissage profond, par exemple, remontant aux LSTM. Cette configuration évite le coût de calcul quadratique de l'attention (c'est-à-dire en évitant d'augmenter progressivement le cache KV par token de l'opérateur d'attention) et peut même aider à résoudre de nouveaux problèmes.

Les modèles mentionnés au début de cet article utilisent un mélange d'approches RNN, certains modèles (Qwen et Kimi) utilisent une idée plus récente appelée Gated DeltaNet (GDN) et d'autres utilisent encore des couches Mamba (Granite et Nemotron). Le modèle Olmo Hybrid que nous lançons aujourd'hui s'inscrit également dans le côté GDN, basé sur des expérimentations minutieuses, et la théorie selon laquelle le GDN est capable d'apprendre des caractéristiques que l'attention ou les couches Mamba ne peuvent pas.

Présentation d'Olmo Hybrid et son efficacité de préentraînement

Olmo Hybrid est un modèle de base de 7 milliards de paramètres, avec 3 points de contrôle post-entraînement expérimentaux publiés — commençant par un modèle Instruct, avec un modèle de raisonnement à venir. C'est le meilleur artefact ouvert pour étudier les modèles hybrides, car il est presque identique à notre modèle Olmo 3 7B de l'automne dernier, juste avec un changement d'architecture. Avec le modèle, nous publions un article contenant une théorie substantielle sur pourquoi les modèles hybrides peuvent être meilleurs que les transformers standards. C'est un long article que je suis encore en train d'explorer personnellement, mais il est excellent. Vous pouvez lire l'article ici et explorer les points de contrôle ici. C'est un projet de recherche incroyable et à long terme dirigé par Will Merrill. Il a fait un excellent travail.

Pour comprendre le contexte de pourquoi les modèles hybrides peuvent constituer une véritable avancée par rapport aux transformers, permettez-moi de commencer par un extrait plus long de l'introduction de l'article, avec mon accent :

Des travaux théoriques passés ont montré que l'attention et la récurrence ont des forces complémentaires (Merrill et al., 2024 ; Grazzi et al., 2025), donc les mélanger est une manière naturelle de construire une architecture avec les avantages des deux primitives. Nous dérivons également de nouveaux résultats théoriques montrant que les modèles hybrides sont même plus puissants que la somme de leurs parties : il existe des problèmes formels liés à l'évaluation de code que ni les transformers ni le GDN ne peuvent exprimer seuls, mais que les modèles hybrides peuvent représenter théoriquement et apprendre empiriquement. Cependant, cette plus grande expressivité n'implique pas immédiatement que les modèles hybrides devraient être de meilleurs LM : ainsi, nous menons des études de mise à l'échelle entièrement contrôlées comparant les modèles hybrides aux transformers, montrant rigoureusement que l'expressivité des modèles hybrides se traduit par une meilleure efficacité des tokens, en accord avec nos observations issues de la course de préentraînement d'Olmo Hybrid. Enfin, nous fournissons une explication théorique sur pourquoi l'augmentation de la puissance expressive d'une architecture devrait améliorer la mise à l'échelle des modèles de langage, ancrée dans la nature multi-tâches de l'objectif de modélisation du langage.

Dans l'ensemble, nos résultats suggèrent que les modèles hybrides dominent les transformers, tant sur le plan théorique, dans leur équilibre entre expressivité et parallélisme, que sur le plan empirique, en termes de performance sur les benchmarks et de capacités en contexte long. Nous croyons que ces découvertes positionnent les modèles hybrides pour une adoption plus large et appelons la communauté de recherche à poursuivre des recherches supplémentaires sur l'architecture.

Essentiellement, nous montrons et soutenons quelques points :

-

Les modèles hybrides sont plus expressifs. Ils peuvent former leurs sorties pour apprendre plus de types de fonctions. Une intuition sur pourquoi cela serait bénéfique pourrait être la suivante : des modèles plus expressifs sont bons en apprentissage profond car nous voulons rendre la classe de modèles aussi flexible que possible et laisser l'optimiseur faire le travail plutôt que d'imposer des contraintes sur l'apprenant. Cela ressemble beaucoup à la Bitter Lesson.

-

Pourquoi la puissance expressive aide-t-elle à l'efficacité ? C'est ici que les choses deviennent plus nuancées. Nous soutenons que des modèles plus expressifs auront de meilleures lois de mise à l'échelle, suivant la quantification.

Brief IA — Veille IA en français

Toutes les innovations mondiales en IA, traduites et résumées automatiquement. Recevoir les meilleures actus IA chaque jour.