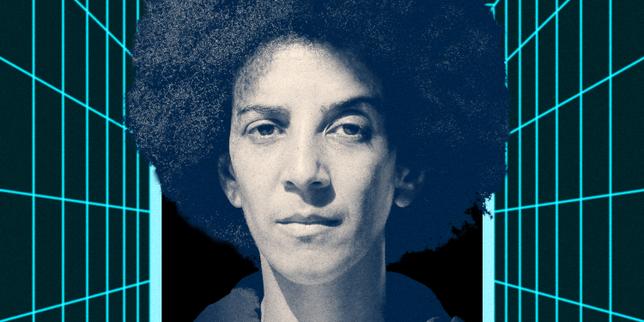

Timnit Gebru, critique éthique des géants de l’IA

Timnit Gebru est la coautrice d’un article considéré comme pionnier dans la critique des grands systèmes d’intelligence artificielle (IA) aujourd’hui utilisés dans les assistants conversationnels ChatGPT (OpenAI), Gemini (Google) ou Claude (Anthropic). Ce texte est paru début 2021, soit presque deux ans avant le lancement du célèbre chatbot d’OpenAI. Intitulé « Des dangers des perroquets stochastiques », il pointait du doigt les risques des modèles de traitement du langage entraînés sur d’immenses quantités de texte et accusés d’en reproduire le contenu sans le comprendre, selon une méthode probabiliste, comme des perroquets.

Ce genre de modèles vont :

- « reproduire et même amplifier les biais contenus dans leurs données d’entraînement »

- « surreprésenter les points de vue dominants »

Le texte mettait notamment en garde contre la présence dans les IA de stéréotypes sexistes, raciaux, etc.

Timnit Gebru en bref

- Éthiopienne, âgée de 43 ans

- Cofondatrice et directrice exécutive de l’institut indépendant de recherche en intelligence artificielle DAIR (Distributed AI Research Institute), créé en 2021

- Codirectrice d’une équipe de recherche en éthique de l’IA chez Google, de 2018 à 2020, quand elle dénonce son licenciement lié à ses travaux et positions

- Doctorat d’ingénierie électrique à l’université de Stanford (Californie), puis passage chez Apple ou Microsoft

Mme Gebru et ses collègues s’inquiétaient aussi de la potentielle exploitation par des « mauvais acteurs » de la capacité de ces systèmes à produire du texte « en apparence cohérent », dans le but de produire des faux, d’inonder les médias sociaux ou de propager des contenus « extrémistes ».

Aussi, l’article alertait sur le « coût environnemental et financier » de la course à des modèles d’IA « toujours plus gros ».

📧

Cet article vous a plu ?

Recevez les 7 meilleures actus IA chaque soir à 19h — résumées en 5 min.