Meta's new AI model predicts how your brain reacts to images, sounds, and speech

Le nouveau modèle d'IA de Meta prédit comment votre cerveau réagit aux images, sons et discours

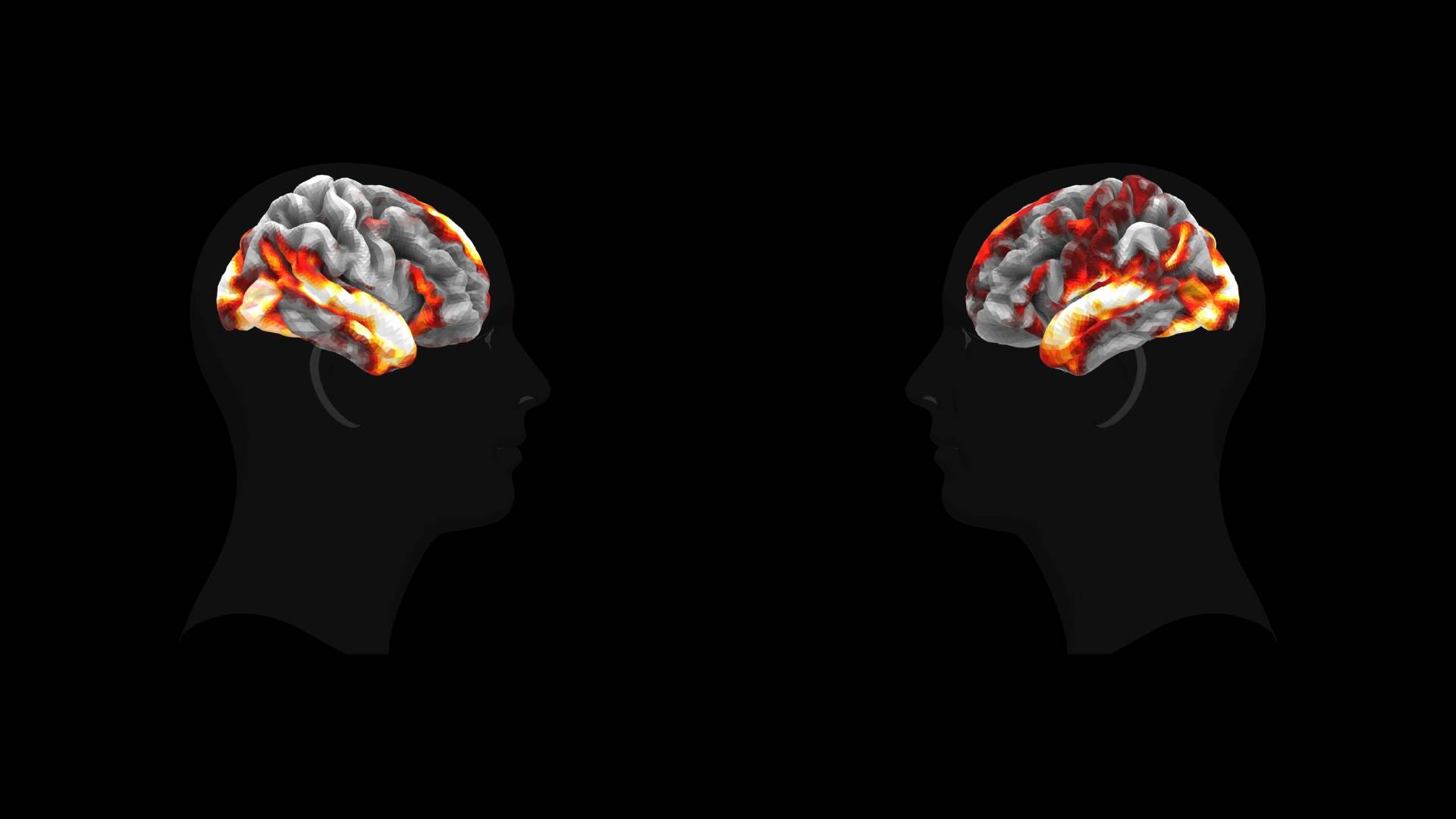

Le modèle d'IA TRIBE v2 de Meta, formé sur des données d'IRMf, prédit comment le cerveau humain réagit aux images, sons et discours, souvent avec une précision supérieure à celle d'une mesure unique d'un individu.

Dans des tests contrôlés, le modèle reproduit avec succès des résultats neuroscientifiques bien connus sur ordinateur, tels que l'identification correcte des régions cérébrales spécialisées pour le traitement des visages, des lieux ou du langage, ce qui pourrait réduire considérablement le temps coûteux en laboratoire dans la recherche cérébrale.

Malgré ses promesses, le modèle présente des limitations : il considère le cerveau comme un récepteur passif, ne couvre que trois canaux sensoriels et fonctionne avec la lente résolution temporelle de l'IRMf. Meta a rendu le code, les poids et une démo interactive disponibles gratuitement.

Un modèle qui prédit l'activité cérébrale

Le modèle TRIBE v2 a été formé sur plus de 1 000 heures de données d'IRMf provenant de 720 sujets. L'imagerie par résonance magnétique fonctionnelle (IRMf) mesure l'activité cérébrale de manière indirecte en suivant les variations du flux sanguin et des niveaux d'oxygène. En utilisant ces données, TRIBE v2 vise à prédire comment un cerveau réagit à tout stimulus visuel, auditif ou basé sur le langage.

Trois modèles Meta pour le prétraitement

TRIBE v2 prend trois types d'entrées : vidéo, audio et texte. Chaque canal passe d'abord par un modèle d'IA pré-entraîné de Meta : Llama 3.2 pour le texte, Wav2Vec-Bert-2.0 pour l'audio, et Video-JEPA-2 pour la vidéo. Ces modèles transforment les données brutes en embeddings qui capturent ce qui est visible dans une image, audible dans un son, ou lisible dans une phrase.

Un transformateur traite ensuite toutes les trois représentations ensemble, identifiant des motifs communs à travers différents stimuli, tâches et individus. Une couche finale spécifique à chaque personne traduit la sortie en une carte cérébrale avec 70 000 voxels, les pixels 3D qui composent une IRMf.

Des prédictions moins bruyantes que les IRMf réelles

Les images IRMf individuelles sont intrinsèquement bruyantes. Les battements de cœur, les mouvements de tête et les artefacts de l'appareil déforment tous le signal. Pour déterminer comment un cerveau répond typiquement à un stimulus donné, les chercheurs doivent moyenner de nombreuses IRMf ensemble.

TRIBE v2 contourne cela en prédisant directement une réponse moyenne ajustée. Dans les tests, cette prédiction a montré une corrélation plus forte avec la moyenne de groupe réelle que la plupart des IRMf individuelles. L'effet était le plus fort dans le jeu de données du Human Connectome Project, capturé avec un scanner de 7 Tesla, offrant une qualité de signal bien supérieure à celle des machines standard de 3 Tesla.

Améliorations par rapport aux modèles linéaires optimisés

Comparé aux modèles linéaires optimisés, qui étaient la méthode de référence pour ce type de prédiction, TRIBE v2 a montré des améliorations significatives sur chaque jeu de données. La version précédente, TRIBE v1, avait été formée sur seulement quatre sujets et prédisait seulement 1 000 voxels au lieu de 70 000, mais elle a tout de même remporté la compétition Algonauts 2025, devançant 263 autres équipes.

La précision des prédictions de TRIBE v2 s'améliore régulièrement avec la quantité de données d'entraînement et n'a pas encore atteint de plateau. Cela suggère que le modèle continuera à s'améliorer à mesure que les bases de données d'IRMf croissent, un schéma qui reflète les lois d'échelle des grands modèles de langage, où plus de données entraînent généralement de meilleures performances.

Des décennies de travail en laboratoire reproduites sur ordinateur

Les chercheurs ont testé TRIBE v2 avec des stimuli quotidiens comme des films et des podcasts, où plusieurs entrées sensorielles frappent le cerveau simultanément, ainsi qu'avec des stimuli isolés typiques des neurosciences classiques. Dans ces configurations contrôlées, une seule image pouvait apparaître à l'écran pendant une seconde pour mesurer la réponse d'une région cérébrale spécifique. L'équipe a utilisé des protocoles de test du jeu de données Individual Brain Charting, une collection d'expériences neuroscientifiques bien établies, et a demandé au modèle de prédire quelles zones cérébrales devraient s'activer.

Dans les expériences visuelles, TRIBE v2 a identifié les régions cérébrales spécialisées connues pour les visages, les lieux, les corps et les personnages.

Cartographie des canaux sensoriels et des régions cérébrales

En désactivant sélectivement des canaux d'entrée individuels, TRIBE v2 révèle combien chaque sens stimule l'activité dans des régions cérébrales spécifiques. Les résultats correspondent aux neurosciences existantes : l'audio prédit le mieux l'activité près du cortex auditif, la vidéo est associée au cortex visuel, et le texte active les zones linguistiques et certaines parties du lobe frontal.

Dans les régions où le cerveau combine les entrées de plusieurs sens, l'alimentation des trois canaux offre les plus grands gains. À la jonction des lobes temporal, pariétal et occipital, la précision des prédictions augmente jusqu'à 50 % par rapport à un seul canal.

Limitations significatives de TRIBE v2

Les limitations de TRIBE v2 restent importantes. L'IRMf ne mesure l'activité cérébrale que de manière indirecte à travers le flux sanguin, avec un délai de plusieurs secondes. Les dynamiques rapides des signaux neuronaux, qui se mesurent en millisecondes, restent cachées. Le modèle ne couvre également que trois canaux sensoriels : l'odorat, le toucher et l'équilibre sont absents.

Plus fondamentalement, TRIBE v2 considère le cerveau comme un récepteur passif des entrées sensorielles. Il ne modélise pas comment le cerveau prend activement des décisions ou entraîne des actions. Il ne peut pas non plus capturer les changements développementaux ou les conditions cliniques, ce que les chercheurs considèrent comme une priorité pour les futures versions.

Meta envisage trois cas d'utilisation pour le modèle : planifier des expériences en neurosciences, construire des architectures d'IA plus proches du fonctionnement du cerveau, et éventuellement diagnostiquer des maladies cérébrales. Le code, les poids du modèle et une démo interactive sont tous disponibles publiquement.

Brief IA — Veille IA quotidienne

Toutes les innovations IA du monde entier, résumées et analysées automatiquement chaque jour.