AI models would rather guess than ask for help, researchers find

Les modèles d'IA préfèrent deviner plutôt que de demander de l'aide, selon des chercheurs

ProactiveBench teste si les modèles de langage multimodaux demandent de l'aide aux utilisateurs lorsque des informations visuelles sont manquantes. Sur 22 modèles testés, presque aucun ne demande ce dont il a besoin, mais une approche simple d'apprentissage par renforcement suggère une solution.

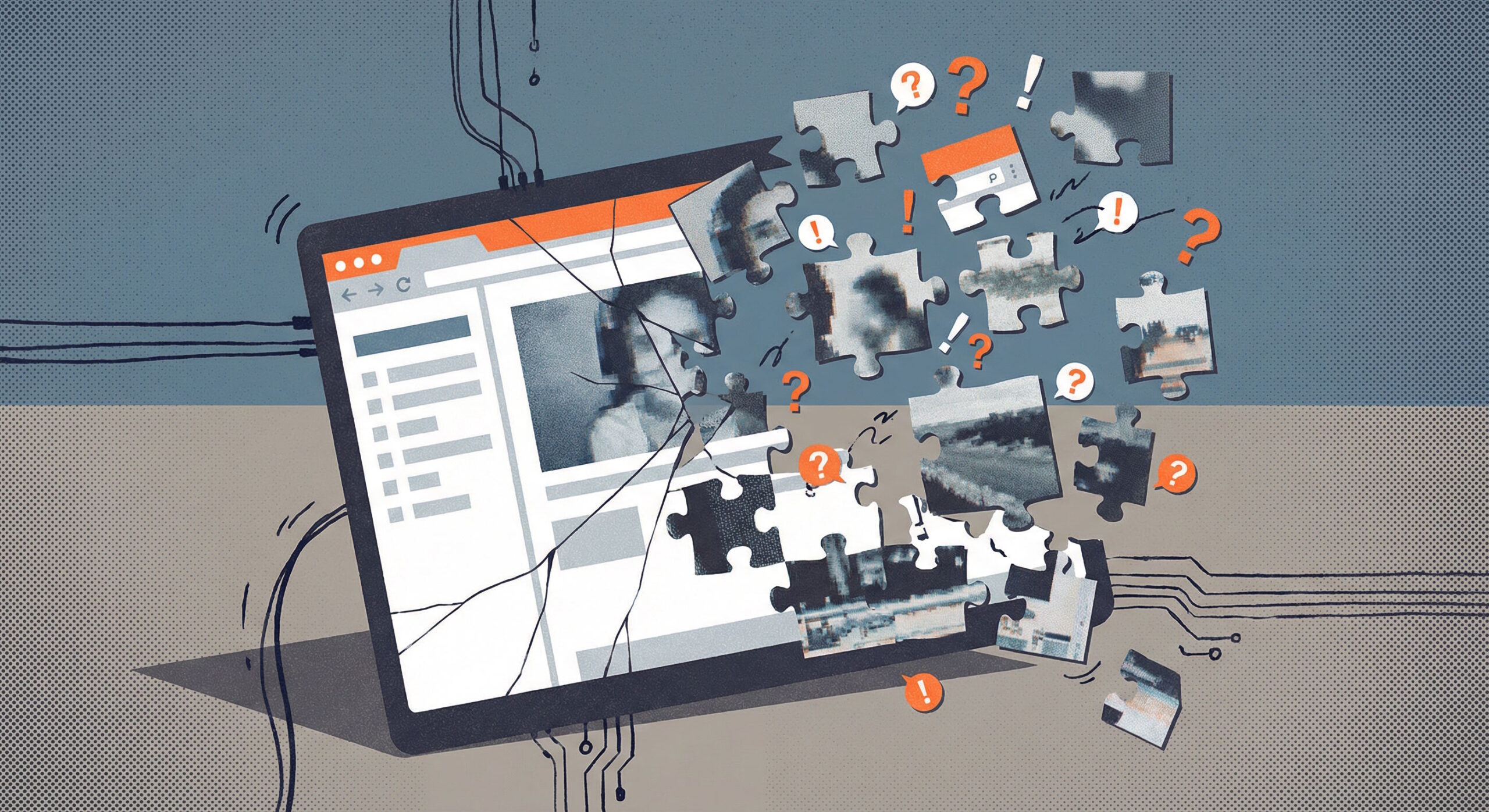

Si vous demandez à une personne d'identifier un objet caché, elle vous demandera de déplacer ce qui bloque la vue. Les modèles de langage multimodaux ne fonctionnent pas de cette manière. Ils hallucinent une réponse incorrecte ou refusent simplement de répondre. Le nouveau benchmark ProactiveBench examine ce problème de près, testant systématiquement si les modèles d'IA actuels peuvent reconnaître quand ils ont besoin d'aide et le demandent réellement.

Les modèles réactifs hallucinent une réponse incorrecte ou refusent de répondre. Un modèle proactif demanderait à déplacer les obstacles, puis donnerait la bonne réponse.

ProactiveBench et ses scénarios

Le benchmark s'appuie sur sept ensembles de données existants et les transforme en scénarios de test impossibles à résoudre sans intervention humaine. Les modèles doivent :

- Identifier des objets cachés

- Nettoyer des images bruyantes

- Interpréter des croquis approximatifs

- Demander différents angles de caméra

Au total, ProactiveBench contient plus de 108 000 images réparties sur 18 000 échantillons. Un filtre intégré élimine toute tâche qu'un modèle peut réussir du premier coup ; pour réussir, un modèle doit demander proactivement plus d'informations.

ProactiveBench couvre sept scénarios : objets occlus (ROD, VSOD), points de vue non informatifs (MVP-N), images bruyantes (ImageNet-C), croquis (QuickDraw), ambiguïtés temporelles (ChangeIt), et mouvements de caméra (MS-COCO). Les modèles proactifs demandent de l'aide ; les réactifs hallucinent ou abandonnent.

Les modèles plus grands ne posent pas de meilleures questions

Les chercheurs ont testé 22 modèles de langage multimodaux, y compris LLaVA-OV, Qwen2.5-VL, InternVL3, GPT-4.1, GPT-5.2 et o4-mini. Dans le cadre de référence avec des objets clairement visibles, les modèles réussissent en moyenne 79,8 % des tâches. Sur ProactiveBench, ce chiffre chute de plus de 60 %.

L'ensemble de données ROD raconte l'histoire la plus frappante. Lorsque des objets sont cachés derrière des blocs, la précision chute de 98,3 % dans le cadre de référence à seulement 8,2 %. Les modèles peuvent repérer des objets sans problème lorsqu'ils sont en vue ; ils n'ont tout simplement jamais l'idée de demander à quelqu'un de les découvrir.

Avec des objets visibles, les modèles affichent une précision moyenne de 79,8 %. Sur ProactiveBench, où ils doivent demander de l'aide, cela tombe à 17,5 %.

La taille du modèle n'aide pas non plus. InternVL3-1B surpasse en fait InternVL3-8B avec 27,1 % contre 12,7 %. L'ancien LLaVA-1.5-7B bat le plus récent LLaVA-OV-72B avec 24,8 % contre 13 %. Le choix du modèle de langage sous-jacent compte également : LLaVA-NeXT avec Vicuna atteint 19,3 %, tandis que la même configuration avec Mistral ne parvient qu'à 4,5 %. Les modèles fermés comme GPT-4.1 affichent les meilleures performances, bien que les chercheurs signalent que leurs scores COCO exceptionnellement élevés pourraient être le résultat d'une contamination des données.

Les modèles qui semblent proactifs ne font souvent que deviner

Certains modèles semblent plus proactifs que d'autres à première vue. Les chercheurs ont soumis cela à un stress-test en remplaçant des suggestions proactives valides par des options absurdes—comme "Rembobinez la vidéo" pour une tâche de croquis. Les modèles qui semblaient auparavant proactifs ont choisi les options sans signification tout aussi volontiers. LLaVA-NeXT Vicuna a même augmenté son taux de sélection de 37 à 49 % lorsqu'on lui a donné des choix erronés. La leçon à retenir est que ce qui ressemble à de la proactivité est en réalité un seuil plus bas pour deviner, et non une véritable compréhension.

Lorsque des suggestions proactives valides sont remplacées par des invalides, des modèles comme LLaVA-OV-0.5B et InternVL3-1B les choisissent quand même. Leur "proactivité" est en fait du devinage, pas de la compréhension.

L'apprentissage par renforcement peut enseigner aux modèles quand parler

Il y a cependant un point positif. Les chercheurs ont montré que la proactivité peut être entraînée. Ils ont affiné LLaVA-NeXT-Mistral-7B et Qwen2.5-VL-3B en utilisant l'Optimisation de Politique Relative de Groupe (GRPO) sur environ 27 000 exemples. Le détail clé : la fonction de récompense attribue un score plus élevé aux prédictions correctes qu'aux suggestions proactives, de sorte que le modèle ne demande de l'aide que lorsqu'il est réellement bloqué.

Après l'entraînement, les deux modèles ont surpassé chacun des 22 modèles précédemment testés, y compris o4-mini (37,4 et 38,6 % contre 34,0 %). La proactivité apprise s'est également transférée à des scénarios en dehors des données d'entraînement. Sur ChangeIt, la précision de Qwen2.5-VL-3B est passée de 12,4 à 55,6 %. Mais si l'équilibre des récompenses est mal géré, tout s'effondre : lorsque les suggestions proactives sont récompensées de la même manière que les réponses correctes, le modèle spamme les demandes d'aide sans cesse, et la précision chute à 5,4 %.

Même avec ces gains, un grand écart subsiste par rapport au cadre de référence (40,7 % contre 75,1 %). Les chercheurs ont publié ProactiveBench en open source et le présentent comme un premier pas vers des modèles qui savent quand ils manquent d'informations et demandent de l'aide au lieu de faire des suppositions.

Les modèles d'IA ne savent pas ce qu'ils ne savent pas

ProactiveBench met en lumière un schéma qui émerge dans les recherches récentes sur l'IA : les modèles de langage multimodaux sont très mauvais pour gérer l'incertitude. Le benchmark WorldVQA de Moonshot AI a récemment révélé que même les modèles de premier plan plafonnent autour de 50 % en reconnaissance d'objets visuels, soulignant une confiance excessive intégrée.

Une étude de Stanford sur ce que les chercheurs appellent l'effet Mirage a renforcé ce point. Des modèles multimodaux comme GPT-5 et Gemini 3 Pro décrivaient avec assurance des détails visuels et offraient des diagnostics médicaux même lorsqu'aucune image n'était fournie. Sur des benchmarks standards, ils atteignent 70 à 80 % de leur performance normale en utilisant uniquement des motifs textuels et des connaissances antérieures, simulant essentiellement une compréhension visuelle sans réaliser que l'entrée était manquante.

D'autres recherches racontent une histoire similaire. Une étude sur la difficulté des questions d'examen a révélé que les modèles de langage ne peuvent pas évaluer de manière fiable leurs propres limites, tandis que des chercheurs de l'Université de Sapienza à Rome ont utilisé leur méthode "Spilled Energy" pour montrer que les hallucinations laissent des traces mesurables dans les calculs d'un modèle—suggérant que même lorsque les modèles ne savent pas qu'ils devinent, les mathématiques en arrière-plan le savent.

Brief IA — Veille IA quotidienne

Toutes les innovations IA du monde entier, résumées et analysées automatiquement chaque jour.