🔬 Researchvia The Decoder·Jonathan Kemper·

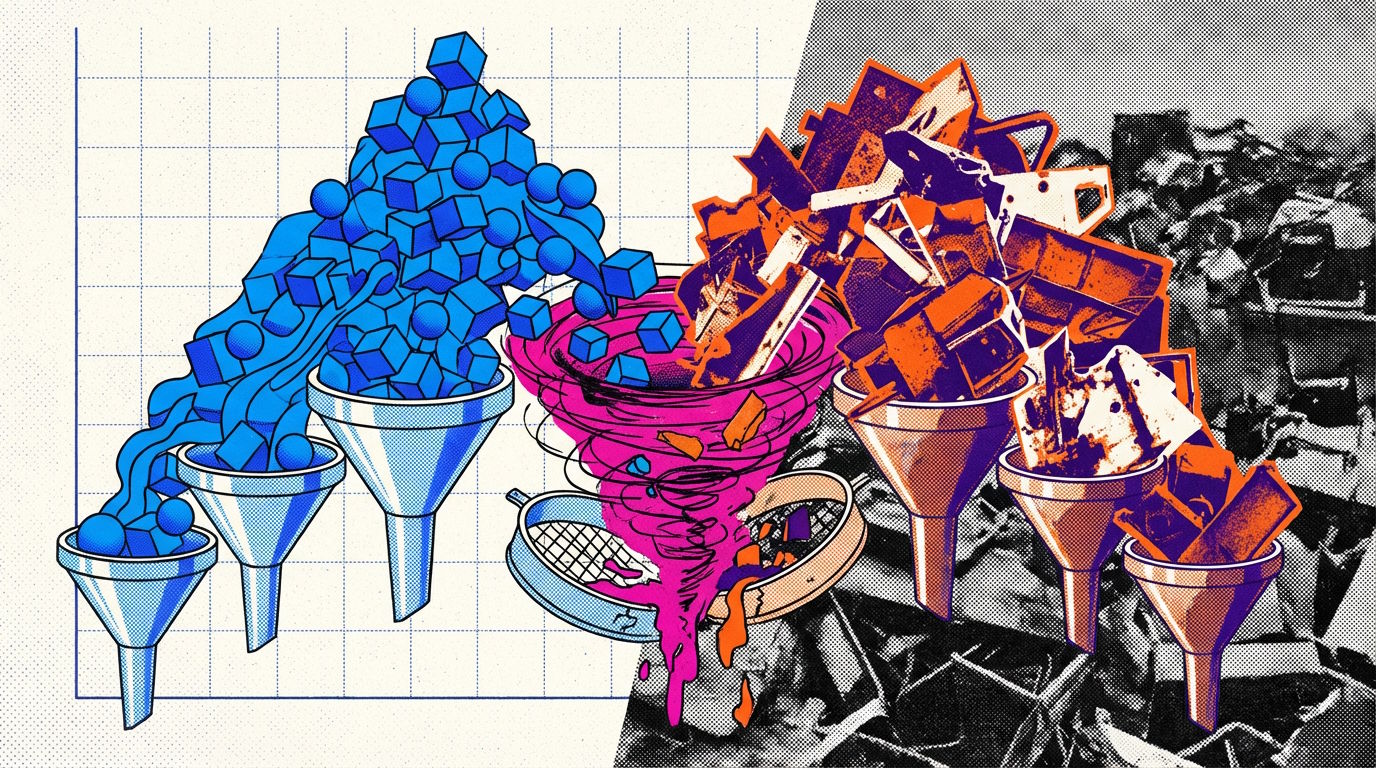

When language models hallucinate, they leave "spilled energy" in their own math

⚡ Résumé en français par Brief IA

•Des chercheurs de l'Université Sapienza de Rome ont identifié des "traces d'énergie renversée" laissées par les modèles linguistiques lors d'hallucinations.

•La nouvelle méthode de détection est sans entraînement et surpasse les techniques précédentes en termes de généralisation.

•Cette avancée pourrait améliorer la fiabilité des modèles linguistiques, un enjeu crucial pour des applications dans des secteurs comme la santé ou le juridique.

💡 Pourquoi c'est important : Améliorer la précision des modèles linguistiques pourrait réduire les risques d'erreurs dans des domaines critiques, augmentant ainsi leur adoption dans des applications sensibles.

📄 Article traduit en français

Lorsque les modèles linguistiques hallucinent

Lorsque les grands modèles linguistiques hallucinent, ils laissent des traces mesurables dans leurs propres calculs. Des chercheurs de l'Université Sapienza de Rome ont développé une méthode sans entraînement qui détecte ces traces et se généralise mieux que les approches précédentes.

L'article "Lorsque les modèles linguistiques hallucinent, ils laissent de l'énergie renversée dans leurs propres calculs" est apparu en premier sur The Decoder.

⚡

Brief IA — Veille IA quotidienne

Toutes les innovations IA du monde entier, résumées et analysées automatiquement chaque jour.