Phi-4-reasoning-vision et les leçons de l'entraînement d'un modèle de raisonnement multimodal

⚡ Résumé en français par Brief IA

📄 Article traduit en français

Phi-4-reasoning-vision et les leçons de l'entraînement d'un modèle de raisonnement multimodal

Phi-4-reasoning-vision-15B est un modèle de raisonnement multimodal compact et intelligent, qui équilibre puissance de raisonnement, efficacité et besoins en données d'entraînement. C'est un modèle largement capable qui permet une interaction naturelle pour une grande variété de tâches vision-langage et excelle dans le raisonnement mathématique et scientifique ainsi que dans la compréhension des interfaces utilisateur.

Nous partageons les leçons apprises et les meilleures pratiques pour l'entraînement d'un modèle de raisonnement multimodal, montrant l'importance de choix architecturaux soignés, d'une curation rigoureuse des données et des avantages d'utiliser un mélange de données de raisonnement et de données non liées au raisonnement.

Nous sommes heureux d'annoncer Phi-4-reasoning-vision-15B, un modèle de raisonnement multimodal à 15 milliards de paramètres, disponible via Microsoft Foundry, HuggingFace et GitHub. Phi-4-reasoning-vision-15B est un modèle largement capable qui peut être utilisé pour une grande variété de tâches vision-langage telles que la légende d'images, la formulation de questions sur des images, la lecture de documents et de reçus, l'aide aux devoirs, l'inférence sur les changements dans des séquences d'images, et bien plus encore. Au-delà de ces capacités générales, il excelle dans le raisonnement mathématique et scientifique et dans la compréhension et l'ancrage des éléments sur les écrans d'ordinateurs et de mobiles. En particulier, notre modèle présente une valeur attrayante par rapport aux modèles open-weight populaires, repoussant la frontière de Pareto du compromis entre précision et coûts de calcul. Nous avons des performances compétitives par rapport à des modèles beaucoup plus lents nécessitant dix fois plus de temps de calcul et de tokens, tout en offrant une meilleure précision que des modèles similaires en termes de rapidité, notamment en ce qui concerne le raisonnement mathématique et scientifique.

Figure 1 : Phi-4-reasoning-vision-15B présente une option convaincante par rapport aux modèles existants, repoussant la frontière de Pareto du compromis entre précision et coûts de calcul. Nous avons des performances compétitives par rapport à des modèles beaucoup plus lents nécessitant plus de temps et de tokens, et une précision supérieure à celle de modèles similaires en termes de rapidité. Ces valeurs ont été calculées en moyennant la précision, le temps et le nombre de tokens de sortie pour un sous-ensemble de 4 benchmarks : ChartQA_TEST, MathVista_MINI, MMMU_VAL, et ScreenSpot_v2, où nous avions enregistré ces valeurs.

Dans cet article, nous partageons les motivations, les choix de conception, les expériences et les enseignements qui ont informé son développement, ainsi qu'une évaluation des performances du modèle et des conseils sur son utilisation. Notre objectif est de contribuer des perspectives pratiques à la communauté sur la construction de modèles de raisonnement multimodal plus petits et efficaces et de partager un modèle open-weight qui est compétitif avec des modèles de taille similaire pour des tâches générales vision-langage, excelle dans l'utilisation d'ordinateurs et dans le raisonnement multimodal scientifique et mathématique.

Un accent sur des modèles vision-langage plus petits et plus rapides

De nombreux modèles vision-langage (VLMs) populaires ont tendance à augmenter en nombre de paramètres et, en particulier, en nombre de tokens qu'ils consomment et génèrent. Cela entraîne une augmentation des coûts d'entraînement et de temps d'inférence, ainsi qu'une latence accrue, ce qui entrave leur utilisabilité pour un déploiement en aval, surtout dans des environnements à ressources limitées ou interactifs.

Une contre-tendance croissante vers des modèles plus petits vise à améliorer l'efficacité, rendue possible par une conception soignée des modèles et une curation des données – un objectif initié par la famille de modèles Phi et poursuivi par Phi-4-reasoning-vision-15B. Nous nous appuyons spécifiquement sur les enseignements des modèles de langage Phi-4 et Phi-4-Reasoning et montrons comment un modèle multimodal peut être entraîné pour couvrir un large éventail de tâches de vision et de langage sans dépendre de jeux de données d'entraînement extrêmement volumineux, d'architectures ou de générations de tokens d'inférence excessives. Notre modèle est conçu pour être suffisamment léger pour fonctionner sur du matériel modeste tout en restant capable de raisonnement structuré lorsque cela est bénéfique. Notre modèle a été entraîné avec beaucoup moins de calcul que de nombreux VLMs open-weight récents de taille similaire. Nous avons utilisé seulement 200 milliards de tokens de données multimodales en tirant parti de Phi-4-reasoning (entraîné avec 16 milliards de tokens) basé sur un modèle central Phi-4 (400 milliards de tokens uniques), comparé à plus de 1 trillion de tokens utilisés pour entraîner des modèles multimodaux comme Qwen 2.5 VL, Kimi-VL, et Gemma3. Nous pouvons donc présenter une option convaincante par rapport aux modèles existants, repoussant la frontière de Pareto du compromis entre précision et coûts de calcul.

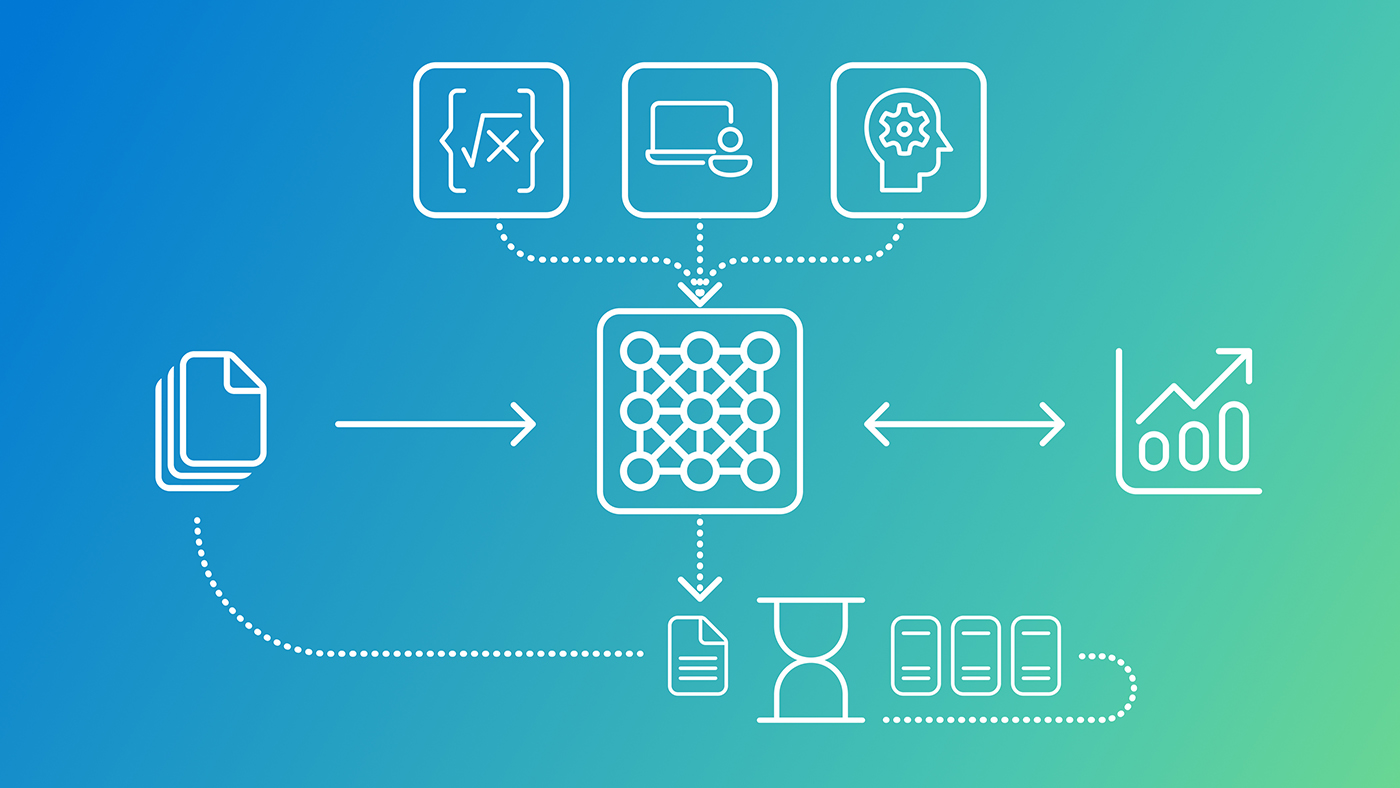

Figure 2 : Phi-4-Reasoning-Vision peut aider avec une large gamme de tâches quotidiennes.

Leçons tirées de l'entraînement d'un modèle multimodal

L'entraînement d'un modèle de raisonnement multimodal soulève de nombreuses questions et nécessite de nombreux choix de conception nuancés concernant l'architecture du modèle, la qualité et la composition du jeu de données, ainsi que l'interaction entre les tâches axées sur le raisonnement et celles axées sur la perception non raisonnée.

Architecture du modèle : fusion précoce vs fusion intermédiaire

Les architectures de modèles pour les VLMs diffèrent principalement par la manière dont l'information visuelle et textuelle est fusionnée. Les modèles de fusion intermédiaire utilisent un encodeur visuel pré-entraîné pour convertir les images en tokens visuels qui sont projetés dans...

Brief IA — Veille IA en français

Toutes les innovations mondiales en IA, traduites et résumées automatiquement. Recevoir les meilleures actus IA chaque jour.